详细介绍

概述

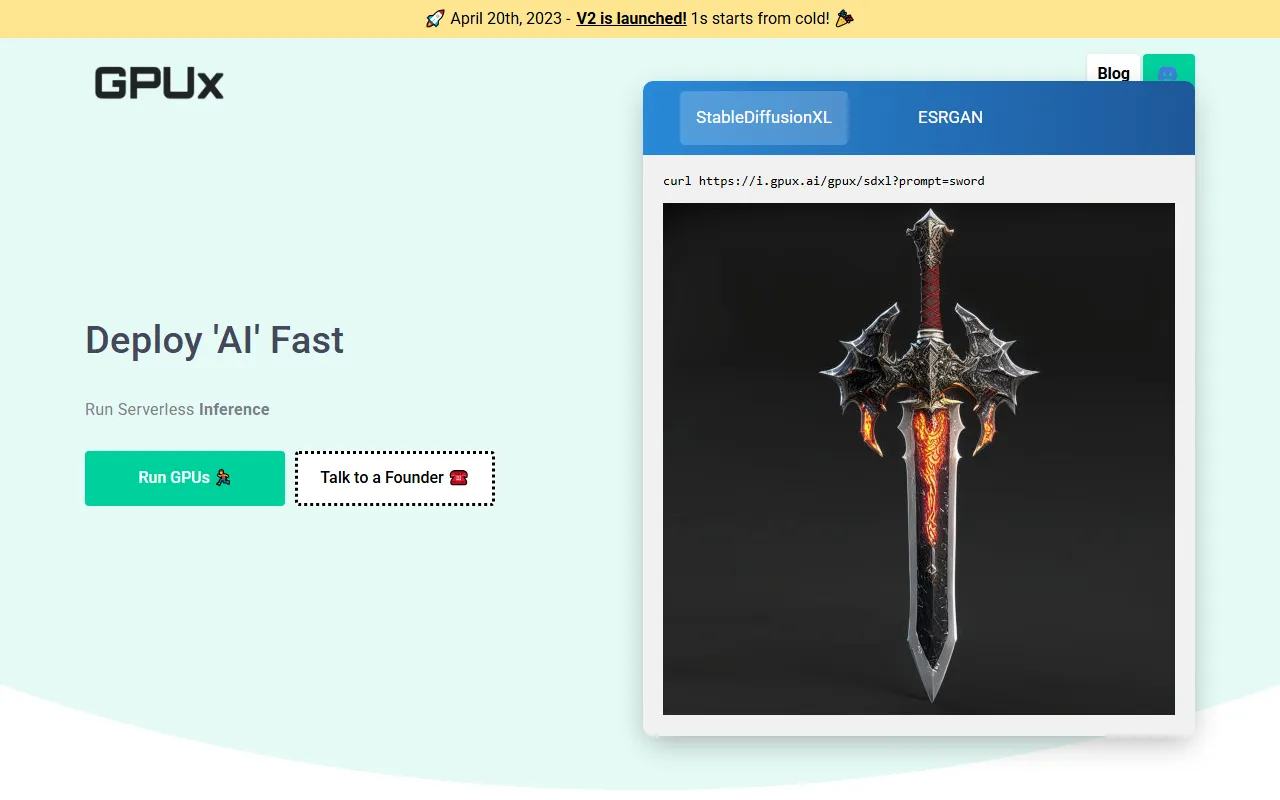

GPUX.AI 是一个面向 AI 开发与编程场景的 GPU 计算服务平台,主要提供可按需调用的 GPU/CPU 算力,用于深度学习、机器学习、图像处理以及模型推理等任务。其核心思路是让开发者能够基于 Docker 容器运行各类 GPU 应用,从而沿用已有的容器化部署流程,降低环境配置与上线门槛。

从官网公开信息来看,GPUX 重点强调 Serverless Inference(无服务器推理)、冷启动速度 与 弹性扩缩容 能力,适合推理请求波动较大的业务场景。平台也展示了 Stable Diffusion XL、Whisper、ESRGAN 等典型 AI 推理应用案例,说明其更偏向为模型部署、推理服务和 GPU 密集型任务提供基础设施支持。

主要功能

-

GPU/CPU 算力资源提供

- 支持深度学习、机器学习、图像处理等计算任务。

- 适合测试、推理及其他 GPU 密集型程序运行。

-

基于 Docker 的 GPU 应用运行

- 可在 Docker 容器中部署和运行任意 GPU 应用。

- 便于开发者复用现有容器镜像和部署流程。

-

Serverless 推理能力

- 官网明确提供 “Fast Run Serverless Inference”。

- 更适合按请求触发的推理任务,而非长期固定占用资源的部署方式。

-

自动扩缩容

- 支持根据推理负载变化进行弹性伸缩。

- 有助于应对流量高峰或请求波动较大的模型服务场景。

-

较快冷启动

- 官网提到 V2 版本支持“1s starts from cold”。

- 对短时调用或低频访问的推理接口更友好。

-

模型推理与示例覆盖

- 官网展示了 StableDiffusionXL、Whisper、ESRGAN、部分 LLM 相关内容。

- 说明平台适用于文生图、语音识别、图像增强等推理任务。

-

文档与 Web 入口

- 提供浏览器端页面与文档入口,方便开发者了解接入与使用方式。

产品定价

目前官网抓取内容中未明确展示标准化定价页面或套餐价格。

对于这类 GPU 资源与推理服务平台,实际费用通常可能与以下因素相关:

- 使用的 GPU/CPU 资源类型

- 推理请求量与运行时长

- 容器部署方式

- 是否涉及自动扩缩容与持久化存储

如需准确报价,建议直接访问官网或联系官方进一步确认。

常见问题

-

GPUX.AI 适合哪些用户?

- 适合需要部署模型推理服务、运行 GPU 容器任务,或按需调用算力的开发者与团队。

-

是否支持自定义应用部署?

- 根据现有介绍,平台支持在 Docker 容器中运行任意 GPU 应用,因此具备较强的自定义部署灵活性。

-

它更适合训练还是推理?

- 从官网最新内容看,GPUX 更突出 推理服务、Serverless Inference 和 弹性扩容,因此更偏向推理场景。

-

是否有公开文档?

- 有,官网提供文档与应用入口,可用于进一步了解产品的接入方式与使用流程。

同类推荐

查看全部Liner.ai 是一款无需编程即可构建和部署机器学习模型的工具,适合没有机器学习背景的用户快速完成训练数据到可集成模型的转换。

Pico 是一个基于 GPT-4 的文本生成应用工具,用户可通过自然语言描述需求,快速创建简单的 Web 应用,适合不具备编程能力但有产品想法的人使用。

Imagica是一款无代码AI应用开发平台,支持用户在不编写代码的情况下构建AI应用,并结合实时数据与多模态能力完成交互式产品设计。

WidgetsAI 是一款面向 AI 应用构建的无代码小部件平台,支持创建、嵌入和白标化 AI 组件,适合希望快速集成 AI 功能而不进行编程的团队或个人。

ComfyUI 是一款面向 Stable Diffusion 的模块化图形界面工具,采用节点式工作流设计,便于用户更细致地控制图像生成过程。

Lightning AI是一个用于构建和部署模型及全栈AI应用的开发框架,提供训练、服务和超参数优化等能力,帮助开发者减少基础设施配置工作。